De la voiture autonome à ChatGPT, l’intelligence artificielle (IA) s’est imposée dans presque tous les secteurs. Elle promet des progrès formidables… mais soulève aussi des interrogations cruciales : que va-t-elle changer dans nos vies ? Quelles limites devons-nous lui fixer ?

Historique

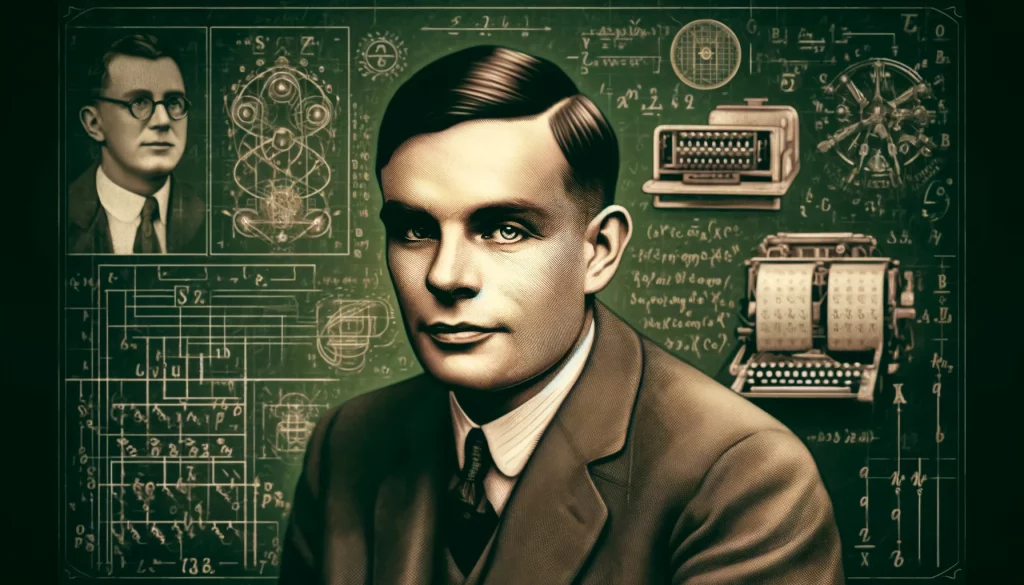

Tout commence avec Alan Turing qui, en 1950, pose la question : « Les machines peuvent-elles penser ? ». Wikipédia+1

Quelques années plus tard, en 1956, des chercheurs du Dartmouth College formalisent le terme « intelligence artificielle ». L’idée d’une machine capable de simuler l’intelligence humaine était née.

Depuis, l’IA a évolué très vite — et les enjeux n’ont cessé de grandir.

Les promesses de l’IA

L’intelligence artificielle offre déjà des applications concrètes :

- En médecine : l’IA aide à détecter des maladies plus tôt, à analyser des imageries médicales, ce qui peut sauver des vies.

- Dans les transports : des véhicules autonomes testent la route, promettant plus de sécurité.

- À l’école : des plateformes adaptatives ajustent les exercices au niveau de chaque élève, favorisant un apprentissage personnalisé.

👉 Mais au-delà des usages, c’est aussi la transformation globale de la société qui est visée : fortifier la recherche, améliorer l’accès aux services, automatiser des tâches répétitives, libérer du temps pour la créativité.

Les limites et les risques

Biais, discrimination et manque de transparence

Un article de Harvard University explique que les outils d’IA « sont utilisés pour décider de l’emploi, du crédit, de la justice » sans que l’on sache toujours comment ils arrivent à leurs décisions. Harvard Gazette

Une étude publiée dans la revue Palgrave Communications montre que les systèmes de recrutement automatisés peuvent conduire à des pratiques discriminantes sur la base du genre, des origines ou de la personnalité. Nature

Emploi et transformation du travail

Une analyse publiée par Microsoft montre que certains métiers de bureau (traducteurs, conseillers financiers, assistants) sont particulièrement à risque face à l’IA, tandis que d’autres, plus manuels ou techniques, semblent plus “à l’abri”. The Times

Régulation, responsabilité et gouvernance

Selon une enquête du Pew Research Center, 62 % des adultes aux États-Unis ne font pas confiance au gouvernement pour bien réguler l’IA, et 55 % souhaitent davantage de contrôle. Pew Research Center Par ailleurs, plus de 20 experts ont signé une lettre ouverte appelant à une régulation renforcée de l’IA pour éviter des risques extrêmes. TIME

Le dilemme de la régulation

« Si on fait trop de règles, on tue l’innovation », préviennent certains industriels. Ainsi, le PDG de Bosch GmbH a récemment averti que l’Europe risquait de « se réguler à mort » et de perdre son avance dans l’IA. Reuters+1

À l’inverse, Eric Horvitz, scientifique de Microsoft Corporation, affirme que « bien régulée, la loi peut faire avancer l’IA plutôt que la freiner ». The Guardian

L’IA et la confiance

Peut-on réellement “faire confiance” à une IA ? Même les experts en doutent. L’étude du Pew Research Center montre que beaucoup pensent que les IA pourraient être utilisées à mauvais escient : manipulation, erreurs, manque de contrôle. Pew Research Center Un expert en politique de l’IA résume : « What we are dealing with is a real and mysterious creature, not a simple and predictable machine. » (Jack Clark) Wikipédia

La question de la responsabilité est aussi centrale : qui “répond” quand une IA décide de manière injuste ? La chercheuse Timnit Gebru, spécialiste des biais algorithmiques, rappelle que seules des équipes humaines peuvent “gouverner” ces systèmes. Wikipédia

L’IA à l’école

L’école aussi est concernée. Des outils d’IA permettent une aide personnalisée aux élèves, mais attention : l’IA ne remplace pas l’enseignant, elle doit être un outil au service de l’apprentissage.

Des études montrent que l’usage de l’IA dans l’éducation doit s’accompagner d’un enseignement de la pensée critique : comprendre ce que fait l’IA, savoir quelles données elle utilise, et rester acteur de sa propre réussite.

L’IA et la manipulation

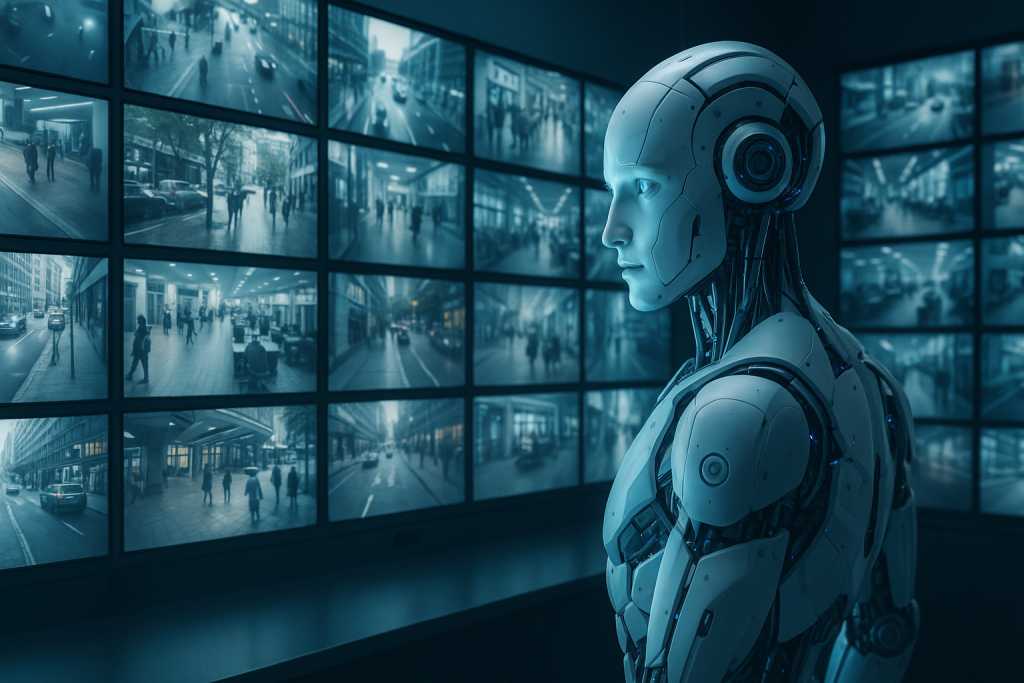

Les algorithmes peuvent analyser nos préférences, recommander des contenus, influencer nos choix. Le blog de CapTechU produit une alerte : « Les algorithmes peuvent être exploités pour la désinformation, manipuler l’opinion, amplifier les divisions sociales. Les deepfakes en sont une illustration. » captechu.edu

L’UNESCO signale que l’IA soulève des problèmes de transparence, de biais et de surveillance massive, notamment dans l’éducation, le travail ou la justice. UNESCO

À retenir

- L’intelligence artificielle est une révolution technologique comparable à l’électricité ou à Internet.

- Elle peut offrir des perspectives incroyables : personnalisation de l’enseignement, amélioration de la santé, gains d’efficacité.

- Mais elle pose aussi des défis majeurs : emploi, vie privée, contrôle, biais, régulation.

- L’IA n’est pas simplement “bien” ou “mal” : elle est un outil. Et comme tous les outils puissants, tout dépend de l’usage qu’on en fait.

Alors, la prochaine fois que tu utiliseras une appli “intelligente”, pose-toi cette question :

« Est-ce moi qui décide… ou l’algorithme ? »